So bauen Sie Ihren Machine-Learning-Stack auf

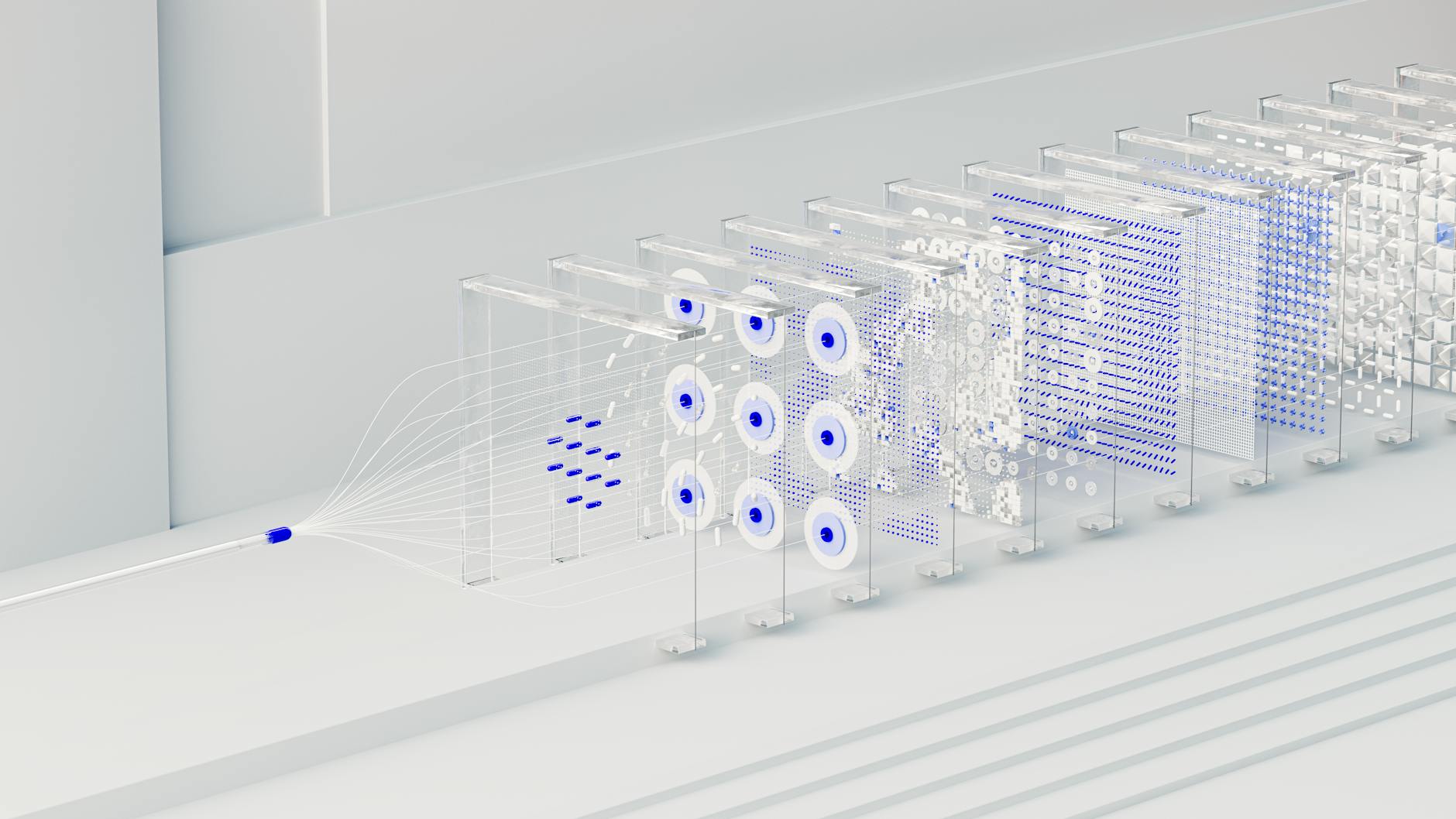

Gehen Sie über Jupyter-Notebooks hinaus. Entdecken Sie die essenziellen Machine-Learning-Tools eines modernen MLOps-Stacks, einschließlich Datenversionierung, Experiment-Tracking, Modell-Deployment und Produktionsüberwachung.

Vom Notebook zur Produktion: Warum Ihr Toolkit entscheidend ist

Viele Wege im Machine Learning beginnen in der komfortablen, interaktiven Umgebung eines Jupyter-Notebooks. Sie ist perfekt für die Exploration, das Prototyping und das anfängliche Modelltraining. Aber ein eigenständiges Notebook ist weit entfernt von einem zuverlässigen, produktionsreifen Machine-Learning-System. Der Weg von einer vielversprechenden .ipynb-Datei zu einer Live-Anwendung, die Tausenden von Nutzern Vorhersagen liefert, ist mit Herausforderungen gepflastert: Reproduzierbarkeit, Skalierbarkeit und Wartbarkeit. Hier kommen MLOps (Machine Learning Operations) und eine wohlüberlegte Auswahl an Machine-Learning-Tools ins Spiel.

MLOps ist die Praxis, DevOps-Prinzipien auf den Lebenszyklus des Machine Learning anzuwenden. Es geht darum, einen automatisierten, wiederholbaren und robusten Prozess für die Entwicklung, Bereitstellung und Wartung von ML-Modellen zu schaffen. Ein einfaches Skript reicht dafür nicht aus. Sie benötigen einen dedizierten „Stack“ – eine Sammlung spezialisierter Tools, die zusammenarbeiten, um jede Phase des Prozesses zu verwalten. Dieser Artikel führt Sie durch die wesentlichen Kategorien von Tools, die einen modernen MLOps-Stack ausmachen, und geht dabei über die bekannten Trainings-Frameworks hinaus, um den gesamten Produktionslebenszyklus abzudecken.

Phase 1: Datenmanagement und Versionierungs-Tools

Im Machine Learning geht es im Grunde um Daten. Wenn Sie Ihre Daten nicht nachverfolgen können, können Sie auch Ihre Modelle nicht reproduzieren. Standard-Versionskontrollsysteme wie Git sind hervorragend für Code, aber sie kapitulieren vor großen Datensätzen. Eine 10 GB große CSV-Datei in einem Git-Repository zu speichern, ist unpraktikabel. Deshalb sind spezialisierte Datenversionierungs-Tools die Grundlage jedes ernsthaften ML-Stacks.

Warum Standard-Tools nicht ausreichen

Das Kernproblem ist, dass Daten im Gegensatz zu Code oft groß, binär und schwer zu „diffen“ sind. Sie benötigen ein System, das Versionen von Datensätzen nachverfolgen kann, ohne Terabytes an Speicherplatz zu duplizieren, und das eine bestimmte Datensatzversion mit dem Code und dem daraus erstellten Modell verknüpft.

Wichtige Tools für das Datenmanagement

- DVC (Data Version Control): Als Open-Source-Favorit arbeitet DVC parallel zu Git, um Ihre Daten zu versionieren. Es speichert die Daten nicht in Ihrem Git-Repo. Stattdessen werden leichtgewichtige Metadateien gespeichert, die auf die eigentlichen Daten verweisen, welche sich in einem Cloud-Speicher wie Amazon S3, Google Cloud Storage oder sogar auf einem freigegebenen Netzlaufwerk befinden können. Dies ermöglicht Ihnen Git-ähnliche Semantiken (

dvc add,dvc push) für große Dateien. - Pachyderm: Dies ist ein umfassenderes Tool für Daten-Pipelines und Datenherkunft (Lineage), das auf Kubernetes aufbaut. Pachyderm erstellt datengesteuerte Pipelines, bei denen jeder Schritt ein Container ist. Wenn sich Eingabedaten ändern, werden automatisch die notwendigen Pipeline-Schritte ausgelöst, was einen vollständigen Audit-Trail (Data Lineage) darüber liefert, wie jeder Output und jedes Modell erstellt wurde.

- Great Expectations: Die Versionierung Ihrer Daten allein reicht nicht aus; Sie müssen auch deren Qualität sicherstellen. Great Expectations ist ein Werkzeug zur Datenvalidierung und -dokumentation. Sie definieren „Erwartungen“ an Ihre Daten (z. B. „Spalte ‘user_id’ muss eindeutig und nicht null sein“). Anschließend werden neue Daten anhand dieser Erwartungen validiert, um zu verhindern, dass fehlerhafte Daten Ihre Trainings-Pipelines beeinträchtigen, und um Sie auf vorgelagerte Datenqualitätsprobleme aufmerksam zu machen.

Phase 2: Experiment-Tracking und Modelltraining

Sobald Ihre Daten verwaltet sind, beginnt die Experimentierphase. Hier testen Sie verschiedene Algorithmen, optimieren Hyperparameter und bewerten die Leistung. Das einfache Ausgeben von Metriken in der Konsole oder das Protokollieren in einer Tabelle wird schnell zu einem unübersichtlichen Chaos. Tools für das Experiment-Tracking sollen Ordnung in dieses Chaos bringen.

Die Herausforderung nicht nachverfolgter Experimente

Stellen Sie sich vor, Sie führen Hunderte von Trainingsdurchläufen durch. Welche Code-Version wurde für Durchlauf #73 verwendet? Was waren die genauen Hyperparameter, die zu diesem einen großartigen Ergebnis führten? Auf welcher Datensatzversion wurde trainiert? Ohne ein Tracking-System sind diese Fragen unmöglich zu beantworten, was Ihre Arbeit nicht reproduzierbar oder erweiterbar macht.

Während das eigentliche Training von Frameworks wie Scikit-learn für klassisches ML und TensorFlow oder PyTorch für Deep Learning übernommen wird, verwalten diese Frameworks nicht den experimentellen Prozess darum herum.

Essenzielle Plattformen für das Experiment-Tracking

- MLflow: Als Open-Source-Plattform von Databricks ist MLflow ein Kraftpaket für die Verwaltung des ML-Lebenszyklus. Seine ‘Tracking’-Komponente ist ein herausragendes Merkmal. Sie fügen Ihrem Trainingsskript ein paar Zeilen Code hinzu, um Parameter und Metriken zu protokollieren und Modell-Artefakte (die trainierten Modelldateien) zu speichern. Es bietet eine übersichtliche Benutzeroberfläche, um Durchläufe zu vergleichen, Ergebnisse zu visualisieren und die leistungsstärksten Modelle zu identifizieren.

- Weights & Biases (W&B): Eine kommerzielle (mit einer großzügigen kostenlosen Stufe) und sehr ausgefeilte Alternative zu MLflow. W&B ist bekannt für seine ansprechenden, interaktiven Dashboards und die tiefe Integration mit gängigen Frameworks. Es zeichnet sich durch die Visualisierung von Trainingsprozessen in Echtzeit, die Verfolgung von Systemmetriken (CPU/GPU-Auslastung) und die Förderung der Zusammenarbeit durch teambasierte Funktionen aus.

- Kubeflow: Mehr als nurps://www.techvizier.com/de-beyond-writing-the-new-wave-of-ai-seo-tools/” class=”internal-link” title=”Mehr als nur Text: Die neue Welle der KI-SEO-Tools”>Mehr als nur ein Experiment-Tracker, ist Kubeflow ein vollwertiges MLOps-Toolkit für Kubernetes. Seine ‘Pipelines’-Komponente ermöglicht es Ihnen, ganze ML-Workflows als Code zu definieren, bei denen jeder Schritt – von der Datenvorverarbeitung bis zum Training und zur Validierung – eine containerisierte Aufgabe ist. Dies ist hervorragend für den Aufbau komplexer, automatisierter Trainings- und Evaluierungssysteme geeignet.

Phase 3: Modell-Deployment und Serving

Ein trainiertes Modell-Artefakt ist nutzlos, bis es in einer Anwendung bereitgestellt wird, wo es Vorhersagen für neue Daten treffen kann. Dies ist oft eine der größten Hürden für Data-Science-Teams. Das Deployment umfasst das Verpacken des Modells, das Bereitstellen über eine API und die Sicherstellung, dass es den Produktionsverkehr mit geringer Latenz bewältigen kann.

Von der Pickle-Datei zur Produktions-API

Das bloße Speichern eines Modells als .pkl-Datei ist keine Deployment-Strategie. Sie benötigen eine robuste Serving-Schicht, die Netzwerkanfragen verarbeiten, Ressourcen verwalten und bei Bedarf skalieren kann. Dies beinhaltet oft die Containerisierung mit Tools wie Docker, um eine portable und isolierte Umgebung für Ihr Modell und seine Abhängigkeiten zu schaffen.

Wichtige Tools für das Model-Serving

- FastAPI / Flask: Für einfache Anwendungsfälle können Sie Ihr Modell in ein Web-Framework wie FastAPI oder Flask einbetten. Sie schreiben einen kleinen Python-Webserver mit einem Endpunkt (z. B.

/predict), der Ihr Modell lädt, eingehende Daten verarbeitet und eine Vorhersage zurückgibt. FastAPI wird oft wegen seiner hohen Leistung (dank asynchroner Fähigkeiten) und der automatischen API-Dokumentation bevorzugt. - BentoML: Ein Open-Source-Framework, das speziell für die Erstellung produktionsreifer Model-Serving-Anwendungen entwickelt wurde. BentoML hilft Ihnen, Ihren Vorhersagecode zu strukturieren, API-Schemata zu definieren und Ihr Modell mit all seinen Abhängigkeiten in einem standardisierten Format zu verpacken. Es vereinfacht den Prozess der Erstellung effizienter, skalierbarer und dockerisierter Model-Serving-Endpunkte.

- Seldon Core: Eine weitere leistungsstarke Open-Source-Plattform, die auf Kubernetes läuft. Seldon Core ist für komplexe Deployment-Muster konzipiert. Es ermöglicht Ihnen nicht nur die Bereitstellung einzelner Modelle, sondern auch anspruchsvoller Inferenzgraphen, einschließlich A/B-Tests (Vergleich zweier Modelle im Live-Betrieb), Canary-Deployments und Multi-Armed Bandits für fortgeschrittenes Modell-Routing.

- Cloud-Plattformen (AWS SageMaker, Vertex AI): Große Cloud-Anbieter bieten gemanagte Dienste für das Modell-Deployment an. Mit wenigen Klicks oder API-Aufrufen können Sie ein Modell-Artefakt auf einem vollständig verwalteten, automatisch skalierenden Endpunkt bereitstellen. Dies abstrahiert die Komplexität der Verwaltung von Servern und Kubernetes, ist aber mit höheren Kosten verbunden und bindet Sie an das Ökosystem eines bestimmten Anbieters.

Phase 4: Monitoring und Observability

Das Deployment ist nicht der letzte Schritt. Die Leistung eines Modells kann im Laufe der Zeit unbemerkt nachlassen, ein Phänomen, das als „Drift“ bekannt ist. Die statistischen Eigenschaften der Live-Daten, die Ihr Modell sieht, können sich ändern und von den Daten abweichen, auf denen es trainiert wurde. Dies wird als Data Drift oder Concept Drift bezeichnet und macht die Vorhersagen Ihres Modells ungültig.

Warum Modelle in der Praxis versagen

Ein Modell, das auf Kundendaten aus dem letzten Jahr trainiert wurde, kann bei Daten aus diesem Jahr schlecht abschneiden, wenn sich das Kundenverhalten geändert hat. Ein Bildklassifizierungsmodell, das unter bestimmten Lichtverhältnissen trainiert wurde, kann bei anderen versagen. Monitoring ist die Praxis der aktiven Überwachung der Modellleistung und der Datenverteilungen, um solche Probleme zu erkennen, bevor sie Ihr Geschäft beeinträchtigen.

Tools für die Modell-Observability

- Evidently AI: Eine Open-Source-Python-Bibliothek zur Evaluierung, zum Testen und zur Überwachung von ML-Modellen. Evidently kann detaillierte interaktive Berichte erstellen, die Ihre Trainingsdaten mit Live-Produktionsdaten vergleichen, Data Drift hervorheben und die Metriken zur Modellqualität im Zeitverlauf verfolgen. Es eignet sich hervorragend für den Aufbau einer robusten Validierungs- und Monitoring-Pipeline.

- Arize AI & Fiddler AI: Dies sind kommerzielle Plattformen, die eine umfassende Lösung für die ML-Observability bieten. Sie gehen über die einfache Drift-Erkennung hinaus und helfen Ihnen bei der Leistungsverfolgung, der Erklärung einzelner Vorhersagen (XAI) und der Identifizierung problematischer Datensegmente. Es sind leistungsstarke Werkzeuge für Teams, die eine große Anzahl kritischer Modelle in der Produktion verwalten.

- Prometheus & Grafana: Für das auf die Technik ausgerichtete Monitoring ist diese klassische Kombination von unschätzbarem Wert. Sie können Ihre Model-Serving-Anwendung so instrumentieren, dass sie Betriebsmetriken (z. B. Latenz, Anfragen pro Sekunde, Fehlerraten) an Prometheus (eine Zeitreihendatenbank) weiterleitet und diese dann in Grafana (einem Dashboarding-Tool) visualisiert. Dies konzentriert sich auf die Gesundheit des Dienstes, die ebenso wichtig ist wie die Qualität der Vorhersagen.

Fazit: Klein anfangen, groß denken

Der Aufbau eines vollständigen MLOps-Stacks kann entmutigend wirken, aber Sie müssen nicht jedes Tool auf einmal einführen. Der Schlüssel ist, schrittweise vorzugehen. Verwenden Sie bei Ihrem nächsten Projekt nicht nur ein Jupyter-Notebook – bringen Sie Ihren Code unter Versionskontrolle. Fügen Sie dann DVC hinzu, um Ihre Daten zu versionieren. Beim darauffolgenden Projekt integrieren Sie MLflow, um Ihre Experimente zu verfolgen. Jeder Schritt verleiht Ihrer Arbeit eine zusätzliche Ebene an Robustheit und Reproduzierbarkeit.

Durch die durchdachte Auswahl und Integration dieser Machine-Learning-Tools können Sie die Lücke zwischen Experiment und Produktion schließen. Sie werden sich von der Erstellung von Modellen hin zum Aufbau zuverlässiger, skalierbarer und wartbarer Machine-Learning-Systeme entwickeln, die kontinuierlichen Mehrwert liefern. Welches Tool werden Sie als Erstes zu Ihrem Stack hinzufügen?