Construyendo tu stack de machine learning

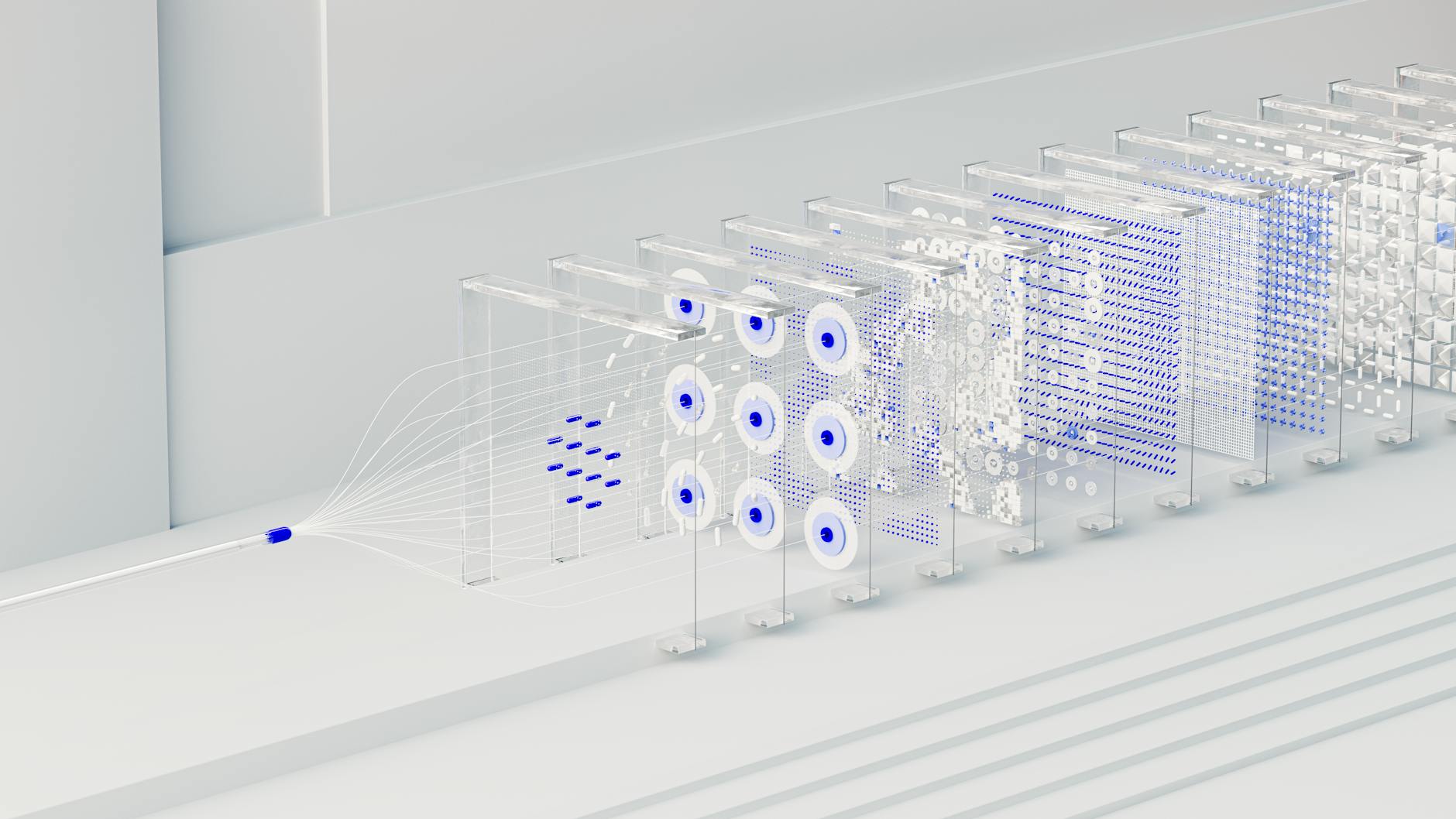

Ve más allá de los notebooks de Jupyter. Explora las herramientas de machine learning esenciales que componen un stack de MLOps moderno, cubriendo el versionado de datos, el seguimiento de experimentos, el despliegue de modelos y la monitorización en producción.

De los notebooks a producción: la importancia de tu conjunto de herramientas

Muchos recorridos en el mundo del aprendizaje automático comienzan en el entorno cómodo e interactivo de un notebook de Jupyter. Es perfecto para la exploración, la creación de prototipos y el entrenamiento inicial de modelos. Pero un notebook por sí solo está a un mundo de distancia de un sistema de aprendizaje automático fiable y listo para producción. El camino desde un prometedor archivo .ipynb hasta una aplicación en vivo que sirve predicciones a miles de usuarios está lleno de desafíos: reproducibilidad, escalabilidad y mantenibilidad. Aquí es donde entran en juego MLOps (Machine Learning Operations) y un conjunto bien elegido de herramientas de machine learning.

MLOps es la práctica de aplicar los principios de DevOps al ciclo de vida del aprendizaje automático. Se trata de crear un proceso automatizado, repetible y robusto para desarrollar, desplegar y mantener modelos de ML. Un simple script no es suficiente. Necesitas un «stack» dedicado: una colección de herramientas especializadas que trabajan juntas para gestionar cada etapa del proceso. Este artículo te guiará a través de las categorías esenciales de herramientas que forman un stack de MLOps moderno, yendo más allá de los frameworks de entrenamiento habituales para cubrir todo el ciclo de vida de producción.

Etapa 1: Herramientas de gestión y versionado de datos

El aprendizaje automático se basa fundamentalmente en los datos. Si no puedes rastrear tus datos, no puedes reproducir tus modelos. Los sistemas de control de versiones estándar como Git son excelentes para el código, pero se colapsan con grandes conjuntos de datos. Almacenar un archivo CSV de 10 GB en un repositorio de Git no es práctico. Es por eso que las herramientas especializadas de versionado de datos son la base de cualquier stack de ML serio.

Por qué las herramientas estándar no son suficientes

El problema principal es que los datos, a diferencia del código, suelen ser grandes, binarios y no se prestan bien a la comparación de diferencias (‘diff’). Necesitas un sistema que pueda rastrear versiones de conjuntos de datos sin duplicar terabytes de almacenamiento, vinculando una versión específica del conjunto de datos con el código y el modelo que produjo.

Herramientas clave para la gestión de datos

- DVC (Data Version Control): Uno de los favoritos de código abierto, DVC trabaja junto a Git para versionar tus datos. No almacena los datos en tu repositorio de Git. En su lugar, guarda metarchivos ligeros que apuntan a los datos reales, los cuales pueden residir en almacenamiento en la nube como Amazon S3, Google Cloud Storage, o incluso en una unidad de red compartida. Esto te proporciona una semántica similar a la de Git (

dvc add,dvc push) para archivos grandes. - Pachyderm: Esta es una herramienta más completa de canalización y linaje de datos construida sobre Kubernetes. Pachyderm crea pipelines impulsados por datos donde cada paso es un contenedor. Cuando los datos de entrada cambian, se activan automáticamente los pasos necesarios del pipeline, proporcionando un rastro de auditoría completo (linaje de datos) de cómo se creó cada resultado y modelo.

- Great Expectations: Versionar tus datos no es suficiente; también necesitas asegurar su calidad. Great Expectations es una herramienta de validación y documentación de datos. Defines «expectativas» para tus datos (p. ej., «la columna ‘user_id’ debe ser única y no nula»). Luego, valida los nuevos datos con estas expectativas, evitando que datos de mala calidad corrompan tus pipelines de entrenamiento y alertándote sobre problemas de calidad de datos en etapas anteriores.

Etapa 2: Seguimiento de experimentos y entrenamiento de modelos

Una vez que tus datos están gestionados, comienza la fase de experimentación. Aquí, probarás diferentes algoritmos, ajustarás hiperparámetros y evaluarás el rendimiento. Simplemente imprimir métricas en la consola o registrarlas en una hoja de cálculo se convierte rápidamente en un caos inmanejable. Las herramientas de//www.techvizier.com/es-ai-video-tools-the-future-of-content-creation/” class=”internal-link” title=”Herramientas de vídeo con AI: el futuro de la creación de contenidos”>herramientas de seguimiento de experimentos están diseñadas para poner orden en este caos.

El desafío de los experimentos sin seguimiento

Imagina ejecutar cientos de trabajos de entrenamiento. ¿Qué versión del código se usó para la ejecución #73? ¿Cuáles fueron los hiperparámetros exactos que produjeron ese único gran resultado? ¿Con qué versión del conjunto de datos se entrenó? Sin un sistema de seguimiento, estas preguntas son imposibles de responder, haciendo que tu trabajo sea imposible de reproducir o desarrollar.

Aunque el entrenamiento principal en sí es manejado por frameworks como Scikit-learn para el ML clásico, y TensorFlow o PyTorch para el deep learning, estos frameworks no gestionan el proceso experimental que los rodea.

Plataformas esenciales de seguimiento de experimentos

- MLflow: Una plataforma de código abierto de Databricks, MLflow es una potente herramienta para gestionar el ciclo de vida del ML. Su componente de ‘Tracking’ es una característica destacada. Añades unas pocas líneas de código a tu script de entrenamiento para registrar parámetros, métricas y guardar los artefactos del modelo (los archivos del modelo entrenado). Proporciona una interfaz de usuario limpia para comparar ejecuciones, visualizar resultados e identificar los modelos con mejor rendimiento.

- Weights & Biases (W&B): Una alternativa comercial a MLflow (con un generoso nivel gratuito) y muy pulida. W&B es conocido por sus atractivos e interactivos dashboards y su profunda integración con frameworks populares. Destaca en la visualización de procesos de entrenamiento en tiempo real, el seguimiento de métricas del sistema (uso de CPU/GPU) y el fomento de la colaboración con funciones para equipos.

- Kubeflow: Más que un simple seguidor de experimentos, Kubeflow es un completo kit de herramientas de MLOps para Kubernetes. Su componente ‘Pipelines’ te permite definir flujos de trabajo de ML completos como código, donde cada paso —desde el preprocesamiento de datos hasta el entrenamiento y la validación— es una tarea en un contenedor. Esto es excelente para construir sistemas de entrenamiento y evaluación complejos y automatizados.

Etapa 3: Despliegue y servicio de modelos

Un artefacto de modelo entrenado es inútil hasta que se despliega en una aplicación donde puede hacer predicciones sobre nuevos datos. Este suele ser uno de los mayores obstáculos para los equipos de ciencia de datos. El despliegue implica empaquetar el modelo, exponerlo a través de una API y asegurar que pueda manejar el tráfico de producción con baja latencia.

Del archivo Pickle a la API de producción

Simplemente guardar un modelo como un archivo .pkl no es una estrategia de despliegue. Necesitas una capa de servicio robusta que pueda manejar peticiones de red, gestionar recursos y escalar según sea necesario. Esto a menudo implica la contenerización con herramientas como Docker para crear un entorno portátil y aislado para tu modelo y sus dependencias.

Herramientas clave para el servicio de modelos

- FastAPI / Flask: Para casos de uso sencillos, puedes envolver tu modelo en un framework web como FastAPI o Flask. Escribes un pequeño servidor web en Python con un endpoint (p. ej.,

/predict) que carga tu modelo, procesa los datos de entrada y devuelve una predicción. FastAPI suele ser preferido por su alto rendimiento (gracias a sus capacidades asíncronas) y su documentación de API automática. - BentoML: Un framework de código abierto diseñado específicamente para construir aplicaciones de servicio de modelos listas para producción. BentoML te ayuda a estructurar tu código de predicción, definir esquemas de API y empaquetar tu modelo y todas sus dependencias en un formato estandarizado. Simplifica el proceso de creación de endpoints de servicio de modelos eficientes, escalables y dockerizados.

- Seldon Core: Otra potente plataforma de código abierto que se ejecuta en Kubernetes. Seldon Core está diseñado para patrones de despliegue complejos. Te permite desplegar no solo modelos individuales, sino grafos de inferencia sofisticados, incluyendo tests A/B (comparando dos modelos en vivo), despliegues canary y multi-armed bandits para un enrutamiento de modelos avanzado.

- Plataformas en la nube (AWS SageMaker, Vertex AI): Los principales proveedores de la nube ofrecen servicios gestionados de despliegue de modelos. Con unos pocos clics o llamadas a la API, puedes desplegar un artefacto de modelo en un endpoint totalmente gestionado y con autoescalado. Esto abstrae la complejidad de gestionar servidores y Kubernetes, pero tiene un coste más alto y te ata al ecosistema de un proveedor específico.

Etapa 4: Monitorización y observabilidad

El despliegue no es el último paso. El rendimiento de un modelo puede degradarse silenciosamente con el tiempo debido a un fenómeno conocido como ‘drift’. Las propiedades estadísticas de los datos en vivo que ve tu modelo pueden cambiar, divergiendo de los datos con los que fue entrenado. Esto se llama **data drift** o **concept drift**, e invalidará las predicciones de tu modelo.

Por qué los modelos fallan en el mundo real

Un modelo entrenado con datos de clientes del año pasado podría tener un bajo rendimiento con datos de este año si los comportamientos de los clientes han cambiado. Un modelo de clasificación de imágenes entrenado en una condición de iluminación puede fallar en otra. La monitorización es la práctica de seguir activamente el rendimiento del modelo y las distribuciones de datos para detectar estos problemas antes de que afecten a tu negocio.

Herramientas para la observabilidad de modelos

- Evidently AI: Una librería de Python de código abierto para evaluar, probar y monitorizar modelos de ML. Evidently puede generar informes interactivos detallados que comparan tus datos de entrenamiento con los datos de producción en vivo, destacando el data drift y siguiendo las métricas de calidad del modelo a lo largo del tiempo. Es excelente para construir un pipeline de validación y monitorización robusto.

- Arize AI & Fiddler AI: Estas son plataformas comerciales que proporcionan una solución completa de observabilidad de ML. Van más allá de la simple detección de drift para ayudarte con el rastreo del rendimiento, la explicación de predicciones individuales (XAI) y la identificación de segmentos de datos problemáticos. Son herramientas potentes para equipos que gestionan un gran número de modelos críticos en producción.

- Prometheus & Grafana: Para una monitorización centrada en la ingeniería, esta combinación clásica es invaluable. Puedes instrumentar tu aplicación de servicio de modelos para exponer métricas operacionales (p. ej., latencia, peticiones por segundo, tasas de error) a Prometheus (una base de datos de series temporales) y luego visualizarlas en Grafana (una herramienta de dashboards). Esto se centra en la salud del servicio, que es tan importante como la calidad de las predicciones.

Conclusión: empieza poco a poco, piensa en grande

Construir un stack de MLOps completo puede parecer abrumador, pero no necesitas adoptar todas las herramientas a la vez. La clave es empezar de forma incremental. En tu próximo proyecto, no te limites a usar un notebook de Jupyter: pon tu código en un control de versiones. Luego, añade DVC para versionar tus datos. Para el siguiente proyecto, integra MLflow para hacer un seguimiento de tus experimentos. Cada paso añade una capa de robustez y reproducibilidad a tu trabajo.

Al seleccionar e integrar cuidadosamente estas herramientas de machine learning, puedes cerrar la brecha entre la experimentación y la producción. Pasarás de crear modelos a construir sistemas de aprendizaje automático fiables, escalables y mantenibles que ofrezcan un valor continuo. ¿Cuál es la primera herramienta que añadirás a tu stack?