Construire votre stack de Machine Learning

Allez au-delà des notebooks Jupyter. Explorez les outils de machine learning essentiels qui composent un stack MLOps moderne, couvrant le versionnage des données, le suivi des expériences, le déploiement de modèles et la supervision en production.

Des notebooks à la production : l’importance de vos outils

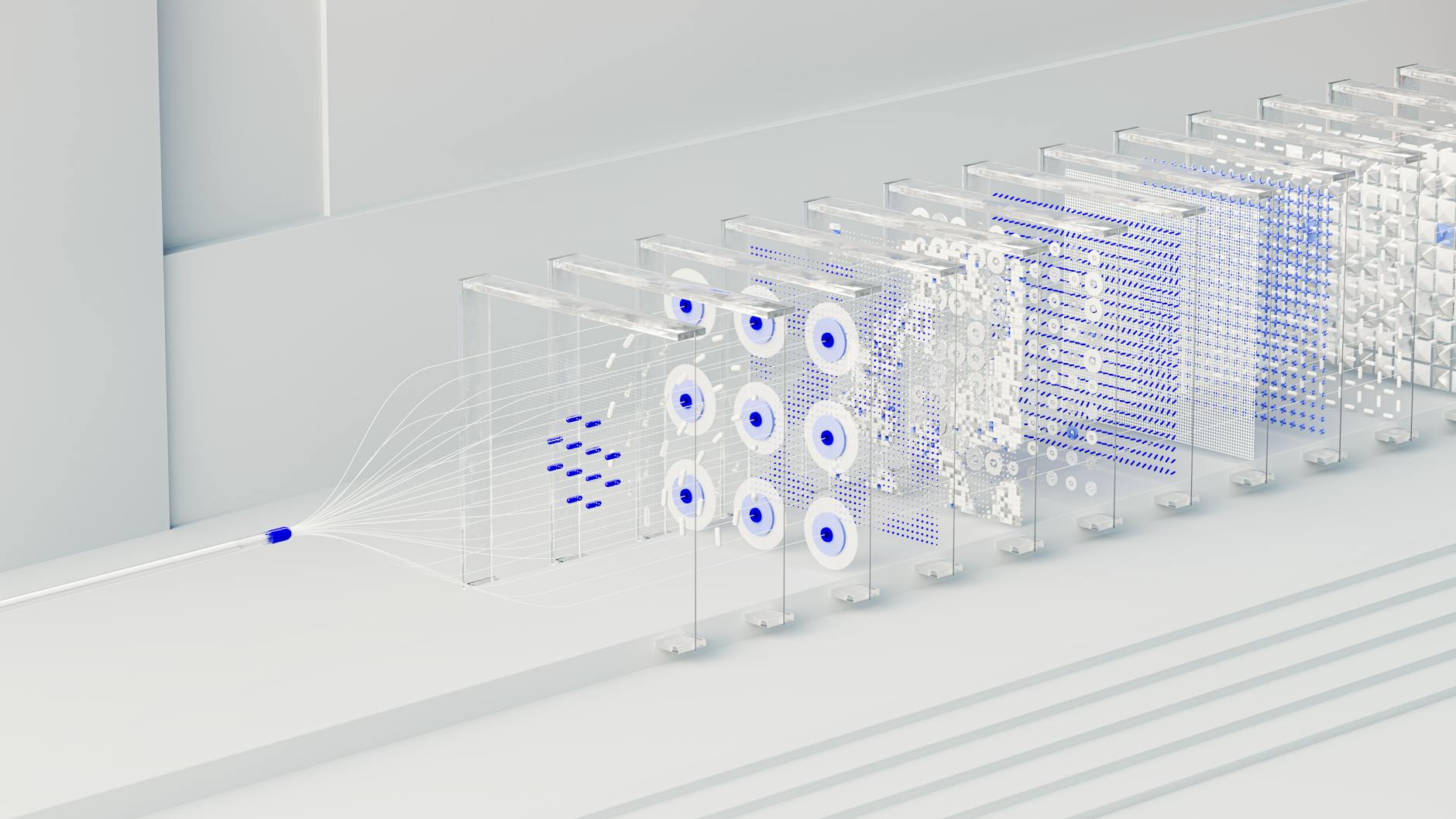

De nombreux parcours en machine learning commencent dans l’environnement confortable et interactif d’un notebook Jupyter. C’est l’outil parfait pour l’exploration, le prototypage et l’entraînement initial des modèles. Mais un notebook seul est à des années-lumière d’un système de machine learning fiable et prêt pour la production. Le chemin qui mène d’un fichier .ipynb prometteur à une application en direct servant des prédictions à des milliers d’utilisateurs est semé d’embûches : reproductibilité, scalabilité et maintenabilité. C’est là que le MLOps (Machine Learning Operations) et un ensemble bien choisi d’outils de machine learning entrent en jeu.

Le MLOps est la pratique qui consiste à appliquer les principes du DevOps au cycle de vie du machine learning. Il s’agit de créer un processus automatisé, répétable et robuste pour développer, déployer et maintenir les modèles de ML. Un simple script ne suffira pas. Vous avez besoin d’un « stack » dédié — une collection d’outils spécialisés qui fonctionnent ensemble pour gérer chaque étape du processus. Cet article vous guidera à travers les catégories d’outils essentielles qui forment un stack MLOps moderne, en allant au-delà des frameworks d’entraînement familiers pour couvrir l’ensemble du cycle de vie de production.

Étape 1 : Outils de gestion et de versionnage des données

Le machine learning repose fondamentalement sur les données. Si vous ne pouvez pas suivre vos données, vous ne pouvez pas reproduire vos modèles. Les systèmes de contrôle de version standards comme Git sont excellents pour le code, mais ils sont inefficaces avec les grands jeux de données. Stocker un fichier CSV de 10 Go dans un dépôt Git est infaisable. C’est pourquoi les outils spécialisés de versionnage de données constituent le fondement de tout stack ML sérieux.

Pourquoi les outils standards ne suffisent pas

Le problème principal est que les données, contrairement au code, sont souvent volumineuses, binaires, et ne permettent pas de visualiser facilement les différences (« diff »). Vous avez besoin d’un système capable de suivre les versions des jeux de données sans dupliquer des téraoctets de stockage, tout en liant une version spécifique d’un jeu de données au code et au modèle qu’elle a permis de produire.

Outils clés pour la gestion des données

- DVC (Data Version Control) : Un favori open-source, DVC fonctionne avec Git pour versionner vos données. Il ne stocke pas les données dans votre dépôt Git. À la place, il stocke des métafichiers légers qui pointent vers les données réelles, lesquelles peuvent se trouver sur un stockage cloud comme Amazon S3, Google Cloud Storage, ou même un lecteur réseau partagé. Cela vous donne une sémantique de type Git (

dvc add,dvc push) pour les fichiers volumineux. - Pachyderm : Il s’agit d’un outil plus complet de pipelining et de lignage de données, construit sur Kubernetes. Pachyderm crée des pipelines pilotés par les données où chaque étape est un conteneur. Lorsque les données d’entrée changent, il déclenche automatiquement l’exécution des étapes nécessaires du pipeline, fournissant une piste d’audit complète (lignage des données) sur la manière dont chaque sortie et chaque modèle ont été créés.

- Great Expectations : Versionner vos données ne suffit pas ; vous devez également garantir leur qualité. Great Expectations est un outil de validation et de documentation des données. Vous définissez des « attentes » pour vos données (par exemple, « la colonne ‘user_id’ doit être unique et non nulle »). Il valide ensuite les nouvelles données par rapport à ces attentes, empêchant les données de mauvaise qualité de corrompre vos pipelines d’entraînement et vous alertant des problèmes de qualité des données en amont.

Étape 2 : Suivi des expériences et entraînement des modèles

Une fois vos données gérées, la phase d’expérimentation commence. C’est là que vous testerez différents algorithmes, ajusterez les hyperparamètres et évaluerez les performances. Le simple fait d’afficher les métriques dans la console ou de les consigner dans une feuille de calcul devient rapidement un désordre ingérable. Les outils de suivi d’expériences sont conçus pour mettre de l’ordre dans ce chaos.

Le défi des expériences non suivies

Imaginez que vous exécutez des centaines de tâches d’entraînement. Quelle version du code a été utilisée pour l’exécution n°73 ? Quels étaient les hyperparamètres exacts qui ont produit ce résultat exceptionnel ? Sur quelle version du jeu de données a-t-il été entraîné ? Sans système de suivi, il est impossible de répondre à ces questions, ce qui rend votre travail impossible à reproduire ou à améliorer.

Bien que l’entraînement de base soit géré par des frameworks comme Scikit-learn pour le ML classique, et TensorFlow ou PyTorch pour le deep learning, ces frameworks ne gèrent pas le processus expérimental qui les entoure.

Plateformes essentielles pour le suivi d’expériences

- MLflow : Une plateforme open-source de Databricks, MLflow est un outil puissant pour gérer le cycle de vie du ML. Son composant ‘Tracking’ est une fonctionnalité phare. Vous ajoutez quelques lignes de code à votre script d’entraînement pour enregistrer les paramètres, les métriques et sauvegarder les artefacts du modèle (les fichiers du modèle entraîné). Il fournit une interface utilisateur claire pour comparer les exécutions, visualiser les résultats et identifier les modèles les plus performants.

- Weights & Biases (W&B) : Une alternative commerciale (avec un généreux niveau gratuit) et très soignée à MLflow. W&B est connu pour ses superbes tableaux de bord interactifs et son intégration profonde avec les frameworks populaires. Il excelle dans la visualisation des processus d’entraînement en temps réel, le suivi des métriques système (utilisation CPU/GPU) et la promotion de la collaboration grâce à des fonctionnalités d’équipe.

- Kubeflow : Plus qu’un simple outil de suivi d’expériences, Kubeflow est une boîte à outils MLOps complète pour Kubernetes. Son composant ‘Pipelines’ vous permet de définir des flux de travail ML entiers sous forme de code, où chaque étape — du prétraitement des données à l’entraînement et à la validation — est une tâche conteneurisée. C’est excellent pour construire des systèmes d’entraînement et d’évaluation complexes et automatisés.

Étape 3 : Déploiement et service des modèles

Un artefact de modèle entraîné est inutile tant qu’il n’est pas déployé dans une application où il peut faire des prédictions sur de nouvelles données. C’est souvent l’un des plus grands obstacles pour les équipes de data science. Le déploiement implique de packager le modèle, de l’exposer via une API et de s’assurer qu’il peut gérer le trafic de production avec une faible latence.

Du fichier Pickle à l’API de production

Le simple fait d’enregistrer un modèle sous forme de fichier .pkl ne constitue pas une stratégie de déploiement. Vous avez besoin d’une couche de service robuste capable de gérer les requêtes réseau, de gérer les ressources et de s’adapter à la charge. Cela implique souvent la conteneurisation avec des outils comme Docker pour créer un environnement portable et isolé pour votre modèle et ses dépendances.

Outils clés pour le service de modèles

- FastAPI / Flask : Pour les cas d’utilisation simples, vous pouvez envelopper votre modèle dans un framework web comme FastAPI ou Flask. Vous écrivez un petit serveur web en Python avec un point de terminaison (par ex.,

/predict) qui charge votre modèle, traite les données entrantes et renvoie une prédiction. FastAPI est souvent préféré pour ses hautes performances (grâce à ses capacités asynchrones) et sa documentation d’API automatique. - BentoML : Un framework open-source conçu spécifiquement pour créer des applications de//www.techvizier.com/fr-ai-productivity-apps-that-actually-work/” class=”internal-link” title=”Les applications de productivité AI qui sont vraiment efficaces”>applications de service de modèles prêtes pour la production. BentoML vous aide à structurer votre code de prédiction, à définir des schémas d’API et à packager votre modèle et toutes ses dépendances dans un format standardisé. Il simplifie le processus de création de points de terminaison de service de modèles efficaces, évolutifs et dockerisés.

- Seldon Core : Une autre plateforme open-source puissante qui fonctionne sur Kubernetes. Seldon Core est conçu pour des schémas de déploiement complexes. Il vous permet de déployer non seulement des modèles uniques, mais aussi des graphes d’inférence sophistiqués, y compris des tests A/B (comparant deux modèles en direct), des déploiements canary et des bandits manchots pour un routage de modèles avancé.

- Plateformes Cloud (AWS SageMaker, Vertex AI) : Les principaux fournisseurs de cloud proposent des services gérés de déploiement de modèles. En quelques clics ou appels d’API, vous pouvez déployer un artefact de modèle sur un point de terminaison entièrement géré et auto-adaptatif. Cela masque la complexité de la gestion des serveurs et de Kubernetes, mais a un coût plus élevé et vous lie à l’écosystème d’un fournisseur spécifique.

Étape 4 : Supervision et observabilité

Le déploiement n’est pas l’étape finale. Les performances d’un modèle peuvent se dégrader silencieusement au fil du temps en raison d’un phénomène connu sous le nom de « drift ». Les propriétés statistiques des données en direct que votre modèle reçoit peuvent changer, s’écartant des données sur lesquelles il a été entraîné. C’est ce qu’on appelle le **data drift** ou le **concept drift**, et cela rendra les prédictions de votre modèle invalides.

Pourquoi les modèles échouent en conditions réelles

Un modèle entraîné sur des données clients de l’année dernière peut avoir de mauvaises performances sur les données de cette année si les comportements des clients ont changé. Un modèle de classification d’images entraîné dans certaines conditions d’éclairage peut échouer dans d’autres. La supervision (ou monitoring) est la pratique consistant à suivre activement les performances du modèle et les distributions de données pour détecter ces problèmes avant qu’ils n’impactent votre activité.

Outils pour l’observabilité des modèles

- Evidently AI : Une bibliothèque Python open-source pour évaluer, tester et superviser les modèles de ML. Evidently peut générer des rapports interactifs détaillés comparant vos données d’entraînement aux données de production en direct, mettant en évidence le data drift et suivant les métriques de qualité du modèle au fil du temps. C’est un excellent outil pour construire un pipeline de validation et de supervision robuste.

- Arize AI & Fiddler AI : Ce sont des plateformes commerciales qui fournissent une solution complète d’observabilité ML. Elles vont au-delà de la simple détection de drift pour vous aider avec le suivi des performances, l’explication des prédictions individuelles (XAI) et l’identification des segments de données problématiques. Ce sont des outils puissants pour les équipes gérant un grand nombre de modèles critiques en production.

- Prometheus & Grafana : Pour la supervision axée sur l’ingénierie, cette combinaison classique est inestimable. Vous pouvez instrumenter votre application de service de modèles pour exposer des métriques opérationnelles (par ex., latence, requêtes par seconde, taux d’erreur) à Prometheus (une base de données de séries temporelles), puis les visualiser dans Grafana (un outil de tableau de bord). Cette approche se concentre sur la santé du service, qui est tout aussi importante que la qualité des prédictions.

Conclusion : commencez petit, visez grand

Construire un stack MLOps complet peut sembler intimidant, mais vous n’avez pas besoin d’adopter tous les outils en même temps. La clé est de commencer progressivement. Pour votre prochain projet, ne vous contentez pas d’utiliser un notebook Jupyter — placez votre code sous contrôle de version. Ensuite, ajoutez DVC pour versionner vos données. Pour le projet suivant, intégrez MLflow pour suivre vos expériences. Chaque étape ajoute une couche de robustesse et de reproductibilité à votre travail.

En sélectionnant et en intégrant judicieusement ces outils de machine learning, vous pouvez combler le fossé entre l’expérimentation et la production. Vous passerez de la simple création de modèles à la construction de systèmes de machine learning fiables, évolutifs et maintenables qui apportent une valeur continue. Quel est le premier outil que vous ajouterez à votre stack ?